|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

Introducción. La tipología y el volumen de tránsito de una red carretera permiten determinar sus condiciones de operación (niveles de servicio) y tendencias de crecimiento, con lo cual es posible desarrollar una planeación oportuna que evite que alguno de los tramos carreteros deje de prestar adecuadamente su función y cumpla con las demandas del usuario (Dirección General de Servicios Técnicos, 2014). Existen diversas técnicas para la automatización del aforo vehicular, los lazos inductivos, sensores de microondas, magnetómetros, sensores piezoeléctricos y visión por computadora son algunos ejemplos (Maldonado et al., 2007). A pesar de que cada una de las técnicas utilizadas a través del tiempo ha generado buenos resultados económicos y técnicos, también tienen sus desventajas. La visión por computadora no solo permite contar y clasificar vehículos, sino que también se puede extraer otro tipo de características como dimensión de objetos, colas de espera, distribución direccional, seguimiento de objetos, velocidad, etc. El uso de imágenes para determinar las características del flujo de tráfico se ha practicado desde los trabajos pioneros de Greenshields (Greenshields, 1934 y Greenshields, 1935). En el artículo “The photographic method of studying traffic behavior”, Greenshields describe su método para recolectar información precisa del comportamiento del tráfico y, usando fotografías, determinar el número de vehículos que pasan por un punto específico, su velocidad y su separación. Más tarde, en su trabajo “A study of traffic capacity”, Greenshields describe los resultados de un estudio llevado a cabo por el Departamento de Carreteras del Estado de Ohio y que inició en 1934, en el que los datos fueron recabados usando su procedimiento fotográfico y que le permitió medir la capacidad de una carretera de dos carriles y el tiempo perdido por los vehículos bajo diferentes niveles de congestionamiento. La disponibilidad cada vez mayor de cámaras de video de imágenes digitales de alta resolución y el abaratamiento de los costos de procesamiento automático de la información generada por esas cámaras por medio de sistemas de cómputo, han hecho posible que cada vez el uso de estas tecnologías sea más atractivo para la obtención de información de tráfico. Su instalación, si bien puede ser costosa en vías existentes, representa ahorros de mantenimiento comparada con los tradicionales lazos de inducción. Además, contrariamente a los métodos tradicionales, las imágenes pueden usarse para distintos propósitos como el conteo, medición de la velocidad y la clasificación de los vehículos que circulen por una carretera; incluso podrían utilizarse para establecer alarmas virtuales para la detección de accidentes o apertura y cierre de nuevas casetas en una plaza de cobro. La visión por computadora tiene como principal objetivo la interpretación automática del campo visual. En la actualidad es aplicada en diversas áreas de la ciencia, tales como: cartografía, astronomía, arqueología, microscopía y muchas otras más. El verdadero potencial de la visión por computadora se da en tareas que consumen mucho tiempo, que implican actividades arduas y peligrosas, y donde factores de error humano como la distracción y el cansancio son muy elevados. Crisóstomo y Yoshimoto (2005) desarrollaron una arquitectura que procesaba imágenes para obtener el volumen de tránsito a través de las técnicas de filtros promedio, dilatación morfológica, resta de imágenes y umbralización. Con dichos procedimientos se obtuvieron vehículos aislados listos para ser segmentados y etiquetados, calculando sus posiciones y dimensiones. Maldonado et al. (2007) automatizan el conteo de vehículos con técnicas tradicionales y una Red Neuronal Artificial (RNA) para la clasificación vehicular. Los resultados fueron buenos, obteniendo un nivel de significancia para el análisis de varianza (alfa) de 0.05. Los problemas presentados en este desarrollo se debieron a los traslapes generados por las sombras de los propios vehículos; el sistema no controlaba los cambios de carril y las salidas de los bordes de la visión de la cámara. Ferraz y Lameda (2008) diseñaron un sistema que extrae las características de vehículos en movimiento a través del procesamiento digital de imágenes y RNAs. Esta aplicación logra solucionar los problemas en la detección de movimiento a través de la Computación Acumulativa y la actualización de fondo, pues propone el fondo adecuado en cada instante de tiempo. Sin embargo, el uso de RNA es computacionalmente muy demandante y puede significar una limitante de las técnicas citadas. Tomando en cuenta los antecedentes descritos y habiendo detectado que los principales problemas en este tipo de sistemas son los fallos positivos (detectar un objeto cuando no lo es) y los fallos negativos (pasar por alto al objeto y no detectarlo), surge el propósito de este trabajo: proponer un conjunto de algoritmos que busquen detectar, segmentar, seguir y clasificar los objetos de un tramo carretero, superando los problemas de traslapes y separación y que además resulten sencillos de programar y que sean computacionalmente más eficientes que aquellos que usan las RNAs. En la segunda sección de este documento se describe la arquitectura propuesta y el modelo integral del sistema de aforo vehicular, cada uno de sus procesos, tales como detección de objetos en movimiento, segmentación, localización de núcleos, clasificación y seguimiento; además de las técnicas y algoritmos de computación acumulativa, ventanas de Parzen, convolución, Análisis de Varianza (ANOVA), detección y control de latencia imperfecta, nuevos vehículos y traslapes/separación. En esta investigación se realizaron pruebas con MATLAB sobre una sola frontera de entrada y salida para evaluar la eficiencia de los algoritmos de manera independiente. Después se hicieron pruebas del sistema completo con la biblioteca de visión artificial OpenCV con C++ en las 8 fronteras de estudio. En la sección 3 se presentan los resultados obtenidos. En la sección 4 se discuten y analizan los resultados. Finalmente, la sección 5 presenta las conclusiones y propone trabajos futuros.

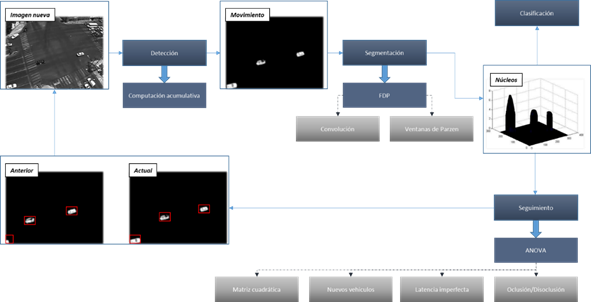

Arquitectura Una vez revisados los distintos trabajos que sirvieron como antecedente a esta investigación, se concluyó que para la detección y aforo vehicular se deberían utilizar los procesos de detección de objetos en movimiento, segmentación, clasificación y seguimiento. Para detectar los objetos se utilizó la técnica de Computación acumulativa; para segmentar y clasificar, la Función de Densidad de Probabilidad de Ventanas de Parzen y Convolución; y por último, para el seguimiento, el análisis de varianza (ANOVA), la matriz de distancia Matriz Cuadrática, Latencia imperfecta, Nuevos vehículos y Traslapes/Separación. La interacción entre procesos y técnicas se muestra en la Figura 1.

Figura 1. Arquitectura general.

El sistema propuesto en este trabajo consiste en el tratamiento de cuadro a cuadro o, dicho de otra manera, comparar la imagen actual en cada instante de tiempo con la imagen anterior.

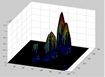

En la figura 2 puede observarse como el sistema procesa cada uno de los cuadros de la secuencia de video. En primera instancia se tiene la imagen nueva o actual. A través de la Computación acumulativa se detectan solo los píxeles que se han movido y se obtiene la imagen de Movimiento. La Función de Densidad de Probabilidad (FDP) junto con la técnica de Convolución y Ventanas de Parzen genera una nueva imagen de Núcleos, donde cada pico de un núcleo representa un vehículo y su altura la clasificación o tamaño. El seguimiento se realiza con un análisis de varianza (ANOVA) para determinar qué tanto se parecen los objetos de la imagen anterior con los de la actual. Los errores causados por traslapes y cambios de luminosidad se reducen a través de una matriz cuadrática de distancias entre los objetos para discriminar los objetos lejanos al vehículo comparado. El procedimiento Nuevos vehículos que gestiona las fronteras de salida y entrada de vehículos en la escena; el procedimiento de Latencia Imperfecta para buscar objetos que el sistema no ha podido detectar durante un determinado número de instantes; y por último, el procedimiento Traslapes y Separación que genera indicadores de traslapes y separación de objetos.

Figura 2. Modelo del sistema.

Resultados La arquitectura descrita en la sección anterior fue aplicada a información obtenida en horario diurno, mediante una cámara de video, con una resolución de 600 megapíxeles, colocada en la intersección de las avenidas Constituyentes y Pasteur Sur en la Ciudad de Santiago de Querétaro, México. La Figura 3 muestra una imagen de dicha intersección. La infraestructura del sitio seleccionado permitió la instalación de la cámara de video a la altura necesaria para lograr la detección de objetos de forma aislada de forma eficiente. Se utilizaron 6 segmentos de video de duración promedio de un minuto y con un número reducido de vehículos en circulación.

Figura 3. Intersección de las avenidas Constituyentes y Pasteur Sur en Santiago de Querétaro, México.

En el cuadro de resultados R-1 se muestran los dos objetos con más baja reflectancia y que por consecuencia son difíciles de ser eliminados por el proceso de Computación Acumulativa. Se cree que el nivel de umbral adecuado para dichos procesos es el mínimo valor de dispersión calculado con base a los niveles de intensidad en los vehículos negros y grises. Por lo tanto, se puede observar que los objetos negros son más problemáticos, pues sus valores máximos de intensidad son casi la mitad de los elementos de los objetos de color gris.

Cuadro R-1. Objetos de baja reflectancia que maximizan el riesgo de ser pasados por alto en el proceso de computación acumulativa.

De la Figura 4 se puede concluir que un

valor de umbral

Figura 4. Resultados obtenidos al aplicar distintos valores de umbral en el proceso de Computación Acumulativa.

La eficiencia del proceso de

segmentación depende directamente del tamaño de ventana

En Figura 5 se puede observar que

Figura 5. Búsqueda del tamaño de ventana óptimo.

En el cuadro de resultados R-2 se

puede observar que el nivel de significancia

Cuadro R-2. Búsqueda de un nivel de significancia óptimo.

En el cuadro de resultados R-3 se puede observar que, al incrementar el número de vehículos en escena, el nivel de error se incrementa; esto es debido principalmente a que el número de traslapes tiende a incrementarse. El aumento en el número de vehículos en escena se asocia directamente al incremento en al número de carriles de circulación considerados que van desde 2 hasta ocho carriles. Además, existen otros factores tales como:

· El ángulo de visión de la cámara se ve modificado y los carriles de circulación que están más cerca del centro de la cámara presentan menos problemas de traslape o separación. · Presencia de objetos de baja reflectancia que se alejan del sensor de video, lo cual afecta al análisis de similitud con ANOVA. · Entre más grande sea la calibración del tamaño de ventana para la estimación de la densidad, la posibilidad de traslapes se incrementa. Por otro lado, si es muy pequeña el número de separaciones aumenta. · Hay vehículos que, al comenzar la escena, están muy cerca de las fronteras de salida, y por consecuente son discriminados por el algoritmo de detección.

Cuadro R-3. Evaluación del sistema.

Conclusiones

Los algoritmos presentados en este artículo resultan útiles cuando se aplican a caminos de cuando más dos carriles, con resultados de calidad comparable y computacionalmente más baratos a los de los métodos que usan las RNAs. Los resultados obtenidos y mostrados en el cuadro R-3 especifican un alto nivel de error, puesto que, aunque los algoritmos de manera independiente generan buenos resultados, una sola cámara no tiene la capacidad de gestionar los ocho carriles de la escena; esto debido a la distorsión generada por el alejamiento de los objetos al área de visión; una cámara posicionada y calibrada por cada una de las fronteras sería la solución óptima. Una aplicación de visión artificial robusta requiere altas capacidades para detectar y controlar traslapes y separaciones. En esta investigación dicho factor depende de la calibración de bajo nivel de error y la correcta identificación de fronteras. Los factores de eficiencia en esta

investigación dependen de la correcta calibración del tamaño de ventana, puesto

que este valor afectará directamente al proceso de segmentación y

clasificación. Una ventana grande facilita la clasificación, pero incrementa la

probabilidad de que existan más fusiones de objetos (traslapes), por otro lado,

una ventana pequeña disminuye la existencia de traslapes, pero

Trabajos futuros

Es posible mejorar el rendimiento del sistema mediante técnicas de programación en paralelo. CUDA (Arquitectura Unificada de Dispositivos de Computo) podría ser una gran oportunidad, ya que este compilador tiene la capacidad de explotar los núcleos del CPU y de forma independiente su unidad de procesamiento gráfico. En esta investigación los objetos que de principio a fin se encuentran ocluidos no son tratados. Es posible complementar con un algoritmo que segmente dichos objetos a través de técnicas de morfología y correspondencia de píxeles. Evaluar la eficiencia del algoritmo de similitud con ANOVA a través de dos cámaras calibradas en altura y distancia, esto con el objetivo de detectar cuando un vehículo entra a escena en los dos sensores de video, de tal forma que sea posible realizar análisis de tiempo de recorrido. Otra buena oportunidad es realizar un análisis sobre clasificación vehicular a través de la altura de los picos gaussianos, la experimentación podría basarse en desviaciones estándar entre muestras de vehículos con distintos tamaños, de tal manera que se propongan umbrales de tamaño y generar una clasificación más robusta.

Bibliografía

Acha Daza, Jorge A. (2015) Nuevas tecnologías para la obtención de información de tráfico. Insituto Mexicano del Transporte. Publicación Técnica No. 468, Sanfandila, Qro, 2015 Blaiotta J., Delieutraz P. Teorema Central del Límite [En línea], Buenos Aires, Argentina, Universidad de Buenos Aires, Facultad de Ciencias Exactas y Naturales, 2004 [consulta, 12 de diciembre de 2015]. Disponible en: http://documents.mx/documents/teorema-del-limite-central-55cd817e3b000.html Congreso Nacional de Control Automático. (I, 2007, Monterrey, México). Hacia un Sistema Automático de Caracterización Vehicular, Asociación de México de Control Automático (AMAC), 2007, pp. 1-6. Crisóstomo-Romero P., Yoshimoto-Ninamango A. Arquitectura para el procesamiento de imágenes de tránsito vehicular, Perú, Grupo de Procesamiento Digital de Señales e Imágenes, Pontificia Universidad Católica del Perú, 2005. Dirección General de Servicios Técnicos. Datos Viales, México, Subsecretaría de Infraestructura, Secretaría de Comunicaciones y Transporte, 2014, p.10. Ferraz A., Lameda C. Extracción automática de características de vehículos en movimiento a partir de videos basada en red neuronal de Kohonen, INGENIERÍA UC, 15(3): 33-44, diciembre, 2008. Garrido J. J. Seguimiento de personas y vehículos por videovigilancia inteligente, tesis (Ingeniería), España, Universidad Autónoma de Barcelona, 2008, pp. 23-49. Gómez E. Aplicación del filtro de partículas al seguimiento de un objeto en 2D y extracción de características, tesis (Ingeniería), España, Universidad Rey Juan Carlos, 2009, pp. 11-13. Greenshields, B.D. (1934). The photographic method of studying traffic behavior. Proceedings of the Annual Meeting of the Highway Research Board, Vol. 13, pp 382-399. Washington, D.C. Greenshields, B.D. (1935). A study of traffic capacity. Proceedings of the Annual Meeting of the Highway Research Board, Vol. 14, pp 448-477. Washington, D.C. Levin R., Rubin D. Estadística para Administración y Economía, 7ma ed., México, Prentice Hall, 2010, pp. 468-475. Rodríguez M. R., Sossa A. H. Procesamiento y Análisis Digital de Imágenes, 1ra ed., Madrid, España, RA-MA Editorial, 2012, pp. 17-19. Sánchez J. Algunos problemas básicos del análisis de varianza, 1ra ed., España, Ediciones Universidad de Salamanca, 1992, p. 25. Wang S., Chung F., Xiong F. A novel image thresholding method based on Parzen window estimate, Pattern Recognition Society, 41: 117-129, 2008.

ASCENCIO Alejandro BUSTOS Agustín SORIA Verónica ACHA Jorge |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||